Ваш мозг – это энергоэффективная “машина прогнозирования”

28.11.2021Результаты нейронных сетей подтверждают идею о том, что мозг использует прогнозы для создания восприятия – и что он работает таким образом, чтобы сохранить энергию, сообщает wired.

Когда нам представляют неоднозначный образ, то, что мы воспринимаем, может зависеть от контекста. Некоторые нейробиологи видят в этом свидетельство того, что мозг собирает свои восприятия сверху вниз, используя предсказания о том, чего он ожидает

Каким образом наш мозг, масса ткани в 1,4 кг, заключенная в костный череп, создает восприятие на основе ощущений – давняя загадка. Обширные доказательства и десятилетия непрерывных исследований показывают, что мозг не может просто собирать сенсорную информацию, как если бы он собирал головоломку, для восприятия своего окружение. Это подтверждается тем фактом, что мозг может построить сцену на основе света, попадающего в наши глаза, даже когда поступающая информация зашумлена и неоднозначна.

Следовательно, многие нейробиологи склоняются рассматривать мозг как «машину предсказания». Посредством обработки прогнозов мозг использует свои предварительные знания о мире, чтобы делать выводы или генерировать гипотезы о причинах поступающей сенсорной информации. Эти гипотезы – а не сами сенсорные данные – вызывают восприятие нашим мысленным взором. Чем более неоднозначен ввод, тем больше полагаются на предварительные знания.

«Прелесть структуры прогнозной обработки [состоит] в том, что она обладает действительно большой – иногда критики могут сказать слишком большой – способностью объяснять множество различных явлений во многих различных системах», – сказал Флорис де Ланге, нейробиолог из Predictive Brain Лаборатория Университета Радбауд в Нидерландах.

Однако растущие нейробиологические доказательства этой идеи в основном носят косвенный характер и открыты для альтернативных объяснений. «Если вы посмотрите на когнитивную нейробиологию и нейровизуализацию на людях, [есть] много доказательств, но суперсимплицитных, косвенных доказательств», – сказал Тим Кицманн из Университета Радбауд, чьи исследования лежат в междисциплинарной области машинного обучения и нейробиологии.

Поэтому исследователи обращаются к вычислительным моделям, чтобы понять и проверить идею интеллектуального мозга. Вычислительные нейробиологи построили искусственные нейронные сети, дизайн которых вдохновлен поведением биологических нейронов, которые учатся делать прогнозы о поступающей информации. Эти модели демонстрируют некоторые сверхъестественные способности, которые, кажется, имитируют способности настоящего мозга. Некоторые эксперименты с этими моделями даже намекают на то, что мозг должен был развиваться как предсказательная машина, чтобы удовлетворить энергетические ограничения.

По мере распространения вычислительных моделей нейробиологи, изучающие живых животных, также все больше убеждаются в том, что мозг учится определять причины сенсорных сигналов. Хотя точные детали того, как мозг это делает, остаются неясными, широкие мазки становятся более четкими.

Бессознательные выводы в восприятии

Прогнозная обработка может поначалу показаться парадоксально сложным механизмом восприятия, но ученые уже давно обращаются к нему, потому что других объяснений, казалось, не хватало. Еще тысячу лет назад арабский астроном и математик-мусульманин Хасан ибн аль-Хайтам выделил ее форму в своей «Книге оптики», чтобы объяснить различные аспекты зрения. Идея набрала силу в 1860-х годах, когда немецкий физик и врач Герман фон Гельмгольц утверждал, что мозг выявляет внешние причины своих поступающих сенсорных сигналов, а не строит свое восприятие «снизу вверх» на основе этих входных данных.

Уильям Лоттер и его консультанты по докторской диссертации в Гарвардском университете создали PredNet, рекурсивную нейронную сеть с архитектурой, предназначенной для выполнения предиктивного кодирования.

Гельмгольц изложил эту концепцию «бессознательного вывода» для объяснения бистабильного или мультистабильного восприятия, при котором изображение может восприниматься более чем одним способом. Это происходит, например, с хорошо известным неоднозначным изображением, которое мы можем воспринимать как утку или кролика: наше восприятие постоянно переключается между двумя изображениями животных. В таких случаях Гельмгольц утверждал, что восприятие должно быть результатом бессознательного процесса нисходящих выводов о причинах сенсорных данных, поскольку изображение, которое формируется на сетчатке, не изменяется.

В течение 20 века когнитивные психологи продолжали доказывать, что восприятие – это процесс активного конструирования, основанный как на сенсорных, так и на нисходящих концептуальных входах. Кульминацией этих усилий стала влиятельная статья 1980 года «Восприятие как гипотезы» покойного Ричарда Лэнгтона Грегори, в которой утверждалось, что иллюзии восприятия – это, по сути, ошибочные предположения мозга о причинах сенсорных впечатлений. Тем временем ученые, занимающиеся компьютерным зрением, не смогли добиться успеха в своих попытках использовать реконструкцию снизу вверх, чтобы компьютеры могли видеть без внутренней «генеративной» модели для справки.

«Попытки осмыслить данные без генеративной модели обречены на провал – все, что можно сделать, это сделать утверждения о закономерностях в данных», – сказал Карл Фристон, компьютерный нейробиолог из Университетского колледжа Лондона.

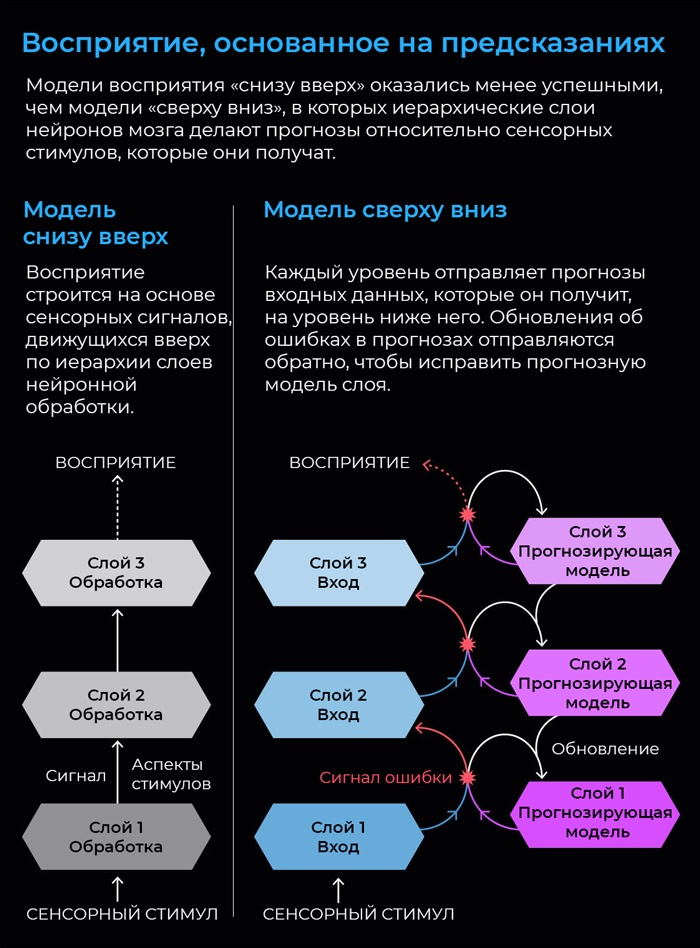

Но по мере того, как признание предсказательной обработки росло, оставались вопросы о том, как это может быть реализовано в мозге. Одна популярная модель, называемая предиктивным кодированием, отстаивает иерархию уровней обработки информации в мозге. Самый высокий уровень представляет собой самые абстрактные знания высокого уровня (например, восприятие змеи в тени впереди). Этот уровень делает прогнозы, ожидая нейронной активности нижележащего уровня, посылая сигналы вниз. Нижний уровень сравнивает свою фактическую активность с предсказанием сверху. Если есть несоответствие, уровень генерирует сигнал ошибки, который течет вверх, чтобы более высокий уровень мог обновить свои внутренние представления.

Этот процесс происходит одновременно для каждой пары последовательных слоев, вплоть до самого нижнего слоя, который получает фактические сенсорные данные. Любое несоответствие между тем, что получено от мира, и тем, что ожидается, приводит к сигналу ошибки, который возвращается вверх по иерархии. Верхний слой в конечном итоге обновляет свою гипотезу (что это была не змея, а просто свернутая веревка на земле).

«В целом идея прогнозирующего кодирования, особенно когда оно применяется к коре головного мозга, состоит в том, что мозг состоит в основном из двух популяций нейронов», – сказал де Ланге: одна, которая кодирует лучший на данный момент прогноз о том, что воспринимается, и другая, которая сигнализирует ошибки в этом предсказании.

В 1999 году компьютерные ученые Раджеш Рао и Дана Баллард (тогда работавшие в Институте биологических исследований Солка и в Университете Рочестера соответственно) построили мощную вычислительную модель прогнозирующего кодирования, в которой нейроны явно использовались для прогнозирования и исправления ошибок. Они смоделировали части пути в системе визуальной обработки мозга приматов, которая состоит из иерархически организованных областей, ответственных за распознавание лиц и объектов. Они показали, что модель может воспроизводить некоторые необычные поведения зрительной системы приматов.

Однако эта работа была проделана до появления современных глубоких нейронных сетей, которые имеют один входной слой, один выходной слой и несколько скрытых слоев, зажатых между ними. К 2012 году нейробиологи использовали глубокие нейронные сети для моделирования вентрального зрительного потока приматов. Но почти все эти модели были сетями прямого распространения, в которых информация течет только от входа к выходу. «Мозг явно не машина с прямой связью», – сказал де Ланге. «В мозгу много обратной связи, примерно столько же, сколько и прямой [передачи сигналов]».

Поэтому нейробиологи обратились к другому типу модели, называемой рекуррентной нейронной сетью (RNN). У них есть особенности, которые делают их «идеальным субстратом» для моделирования мозга, по словам Канаки Раджана, вычислительного нейробиолога и доцента Медицинской школы Икана на горе Синай в Нью-Йорке, чья лаборатория использует RNN для понимания функций мозга. RNN имеют как прямую, так и обратную связь между своими нейронами, и они имеют постоянную текущую активность, которая не зависит от входных сигналов. «Способность воспроизводить эту динамику в течение очень длительного периода времени, по сути, навсегда, – вот что дает этим сетям возможность затем обучаться», – сказал Раджан.

Прогнозирование энергоэффективно

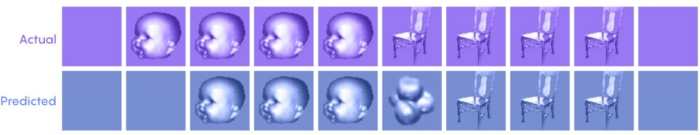

RNN привлекли внимание Уильяма Лоттера и его консультантов по докторской диссертации Дэвида Кокса и Габриэля Креймана из Гарвардского университета. В 2016 году команда продемонстрировала RNN, которая научилась предсказывать следующий кадр в видеопоследовательности. Они назвали это PredNet («Я возьму на себя вину за то, что у меня недостаточно творчества, чтобы придумать что-то лучшее», – сказал Лоттер). Команда разработала RNN в соответствии с принципами прогнозирующего кодирования как иерархию из четырех уровней, каждый из которых прогнозирует входные данные, которые он ожидает от уровня ниже, и отправляет сигнал ошибки вверх, если есть несоответствие.

Затем они обучили сеть видеозаписям городских улиц, снятым камерой, установленной на автомобиле. PredNet научился непрерывно предсказывать следующий кадр в видео. «Мы не знали, сработает ли это на самом деле», – сказал Лоттер. «Мы попробовали это и увидели, что он действительно делает прогнозы. И это было круто».

Следующим шагом было подключение PredNet к нейробиологии. В прошлом году в журнале Nature Machine Intelligence Лоттер и его коллеги сообщили, что PredNet демонстрирует поведение, наблюдаемое в мозге обезьяны в ответ на неожиданные стимулы, в том числе те, которые трудно воспроизвести в простых сетях прямого распространения.

«Это фантастическая работа, – сказал Кицманн о PredNet. Но он, Марсель ван Гервен и их коллеги из Radboud стремились к чему-то более фундаментальному: и модель Рао, и Балларда, и PredNet явно включали искусственные нейроны для прогнозирования и исправления ошибок, а также механизмы, которые вызывали правильные нисходящие предсказания для подавления ошибок нейронов. Но что, если они не были указаны явно? «Мы задавались вопросом, действительно ли нужны все эти архитектурные ограничения, или нам удастся применить еще более простой подход», – сказал Кицманн.

Кицманну и ван Гервену пришло в голову, что нейронная коммуникация требует больших затрат энергии (мозг – самый энергоемкий орган в теле). Следовательно, потребность в экономии энергии может ограничивать поведение любой развивающейся нейронной сети в организмах.

Исследователи решили посмотреть, может ли какой-либо из вычислительных механизмов для прогнозирующего кодирования появиться в RNN, которые должны выполнять свои задачи, используя как можно меньше энергии. Они посчитали, что сильные стороны связей, также известные как веса, между искусственными нейронами в их сетях могут служить посредником для синаптической передачи, что и составляет большую часть использования энергии в биологических нейронах. «Если вы уменьшите вес между искусственными единицами, это означает, что вы будете общаться с меньшим энергопотреблением», – сказал Кицманн. «Мы воспринимаем это как минимизацию синаптической передачи».

Когда PredNet, нейронная сеть с архитектурой прогнозирующего кодирования, была представлена кадрами в видеопоследовательности (вверху), она научилась их предсказывать (внизу). ИЛЛЮСТРАЦИЯ: QUANTA MAGAZINE; ИСТОЧНИК: LOTTER ET AL., NATURE MACHINE INTELLIGENCE 2020

Затем команда обучила RNN многочисленным последовательностям последовательных цифр в возрастающем, циклическом порядке: 1234567890, 3456789012, 6789012345 и так далее. Каждая цифра была показана сети в виде изображения размером 28 на 28 пикселей. RNN изучила внутреннюю модель, которая могла предсказать, какой будет следующая цифра, начиная с любого случайного места в последовательности. Но сеть была вынуждена сделать это с наименьшими возможными весами между единицами, что аналогично низким уровням нейронной активности в биологической нервной системе.

В этих условиях RNN научилась предсказывать следующее число в последовательности. Некоторые из его искусственных нейронов действовали как «блоки предсказания», представляющие модель ожидаемых входных данных. Другие нейроны действовали как «единицы ошибки», которые были наиболее активными, когда единицы предсказания еще не научились правильно предвидеть следующее число. Эти единицы ошибок стали подавленными, когда единицы предсказания начали делать это правильно. Важно отметить, что сеть пришла к этой архитектуре, потому что она была вынуждена минимизировать потребление энергии. «Он просто учится сдерживать то, что люди обычно явно встраивают в систему», – сказал Кицманн. «Наша система делает это прямо из коробки, чтобы быть энергоэффективной».

Вывод состоит в том, что нейронная сеть, которая минимизирует потребление энергии, в конечном итоге реализует своего рода прогностическую обработку, что свидетельствует о том, что биологический мозг, вероятно, делает то же самое.

Раджан назвал работу Кицмана «очень изящным примером того, как нисходящие ограничения, такие как минимизация энергии, могут косвенно привести к определенной функции, такой как прогнозирующее кодирование». Это побудило ее задуматься, могло ли появление определенных ошибок и блоков предсказания в RNN быть непреднамеренным следствием того факта, что только нейроны на краю сети получали входные данные. Если бы входные данные были распределены по сети, «я безумно догадываюсь, что вы не найдете разделения между единицами ошибок и единицами прогнозирования, но вы все равно обнаружите прогнозирующую активность», – сказала она.

Объединяющая основа для поведения мозга

Какими бы убедительными ни казались эти выводы компьютерных исследований, в конце концов, только данные, полученные на основе живого мозга, могут убедить нейробиологов в возможности обработки прогнозов в мозге. С этой целью Блейк Ричардс, нейробиолог и компьютерный ученый из Университета Макгилла, и Мила, Квебекский институт искусственного интеллекта, и его коллеги сформулировали несколько четких гипотез о том, что они должны видеть в мозге, который учится предсказывать неожиданные события.

Чтобы проверить свои гипотезы, они обратились к исследователям из Института исследований мозга Аллена в Сиэтле, которые проводили эксперименты на мышах, отслеживая нейронную активность в своем мозгу. Особый интерес вызвали определенные пирамидные нейроны в неокортексе головного мозга, которые, как считается, анатомически подходят для обработки прогнозов. Они могут получать как локальные восходящие сенсорные сигналы от соседних нейронов (через входы в их клеточное тело), так и нисходящие предсказательные сигналы от более отдаленных нейронов (через их апикальные дендриты).

Мышам показали множество последовательностей пятен Габора, которые состоят из полос света и темноты. Все четыре пятна в каждой последовательности имели примерно одинаковую ориентацию, и мыши этого и ожидали. («Должно быть, было чертовски скучно просто наблюдать за этими последовательностями», – сказал Ричардс.) Затем исследователи вставили неожиданное событие: четвертый патч Габора произвольно повернул в другую сторону. Сначала животные были удивлены, но со временем стали ожидать и элемента неожиданности. Все это время исследователи наблюдали за активностью мозга мышей.

Они увидели, что многие нейроны по-разному реагировали на ожидаемые и неожиданные раздражители. Важно отметить, что эта разница была сильной в локальных восходящих сигналах в первый день тестирования, но уменьшилась во второй и третий дни. В контексте прогнозной обработки это предполагало, что вновь сформированные нисходящие ожидания начали подавлять реакции на поступающую сенсорную информацию, поскольку стимулы становились менее неожиданными.

Между тем в апикальных дендритах происходило обратное: разница в их реакции на неожиданные раздражители со временем увеличивалась. Казалось, что нейронные цепи учатся лучше представлять свойства неожиданных событий, чтобы делать более точные прогнозы в следующий раз.

«Это исследование дополнительно подтверждает идею о том, что в неокортексе происходит что-то вроде предсказательного обучения или предсказательного кодирования», – сказал Ричардс.

Верно, что отдельные наблюдения за нейрональной активностью или поведением животных иногда можно объяснить с помощью какой-либо другой модели мозга. Например, ослабление реакции нейронов на один и тот же входной сигнал вместо того, чтобы интерпретироваться как подавление ошибочных единиц, может быть просто результатом процесса адаптации. Но затем «вы получаете целую телефонную книгу с объяснениями различных явлений», – сказал де Ланге.

С другой стороны, предиктивная обработка данных обеспечивает объединяющую основу для объяснения многих явлений за один прием, отсюда и ее привлекательность как теории о том, как работает мозг. «Я думаю, что доказательства на данный момент довольно убедительны», – сказал Ричардс. – На самом деле, я готов поставить кучу денег на это заявление.